TPU

Définition

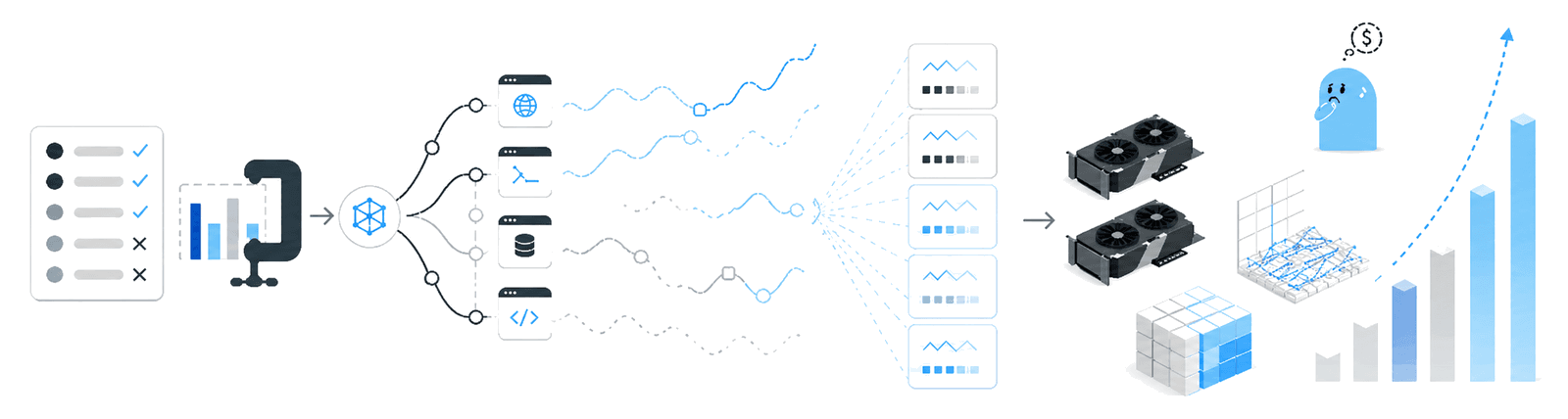

Processeur spécialisé conçu par Google pour accélérer l'entraînement et l'inférence des modèles IA. Contrairement aux GPUs généralistes, les TPUs (Tensor Processing Units) sont optimisés pour les calculs matriciels massifs que demandent les réseaux de neurones.

Google utilise des milliers de TPUs pour entraîner Gemini, son grand modèle de langage. Des startups louent du temps de TPU sur le cloud Google pour rendre l'IA moins coûteuse.

Comprendre les TPUs te montre qu'il existe des alternatives au GPU pour l'IA, et que le hardware détermine qui peut entraîner les plus gros modèles.

Voir aussi

Articles qui en parlent

Évaluer l'IA coûte désormais plus cher que l'entraîner

L'évaluation des modèles IA est devenue si chère qu'elle redéfinit qui peut faire de la recherche.

L'IA pour PME et TPE françaises en 2026 : par où commencer

En 2026, intégrer l'IA dans ta PME ou TPE n'est plus une option — voici comment le faire concrètement, sans budget colossal.

Les meilleurs outils IA pour le service client en 2026

Tidio, Intercom Fin, Zendesk AI ou Front : lequel automatise vraiment ton support sans casser ton budget ?

Automatiser ses réseaux sociaux avec l'IA en 2026 : guide complet

Publie moins souvent, reste présent partout : voici comment l'IA gère tes réseaux à ta place.

Prompt Engineering : le guide pratique en français pour 2026

Maîtriser le prompt engineering, c'est transformer une IA ordinaire en assistant qui travaille vraiment pour toi.

50 prompts ChatGPT qui marchent vraiment en 2026 (classés par usage)

50 prompts ChatGPT testés, classés par usage, pour arrêter de perdre du temps avec des résultats médiocres.